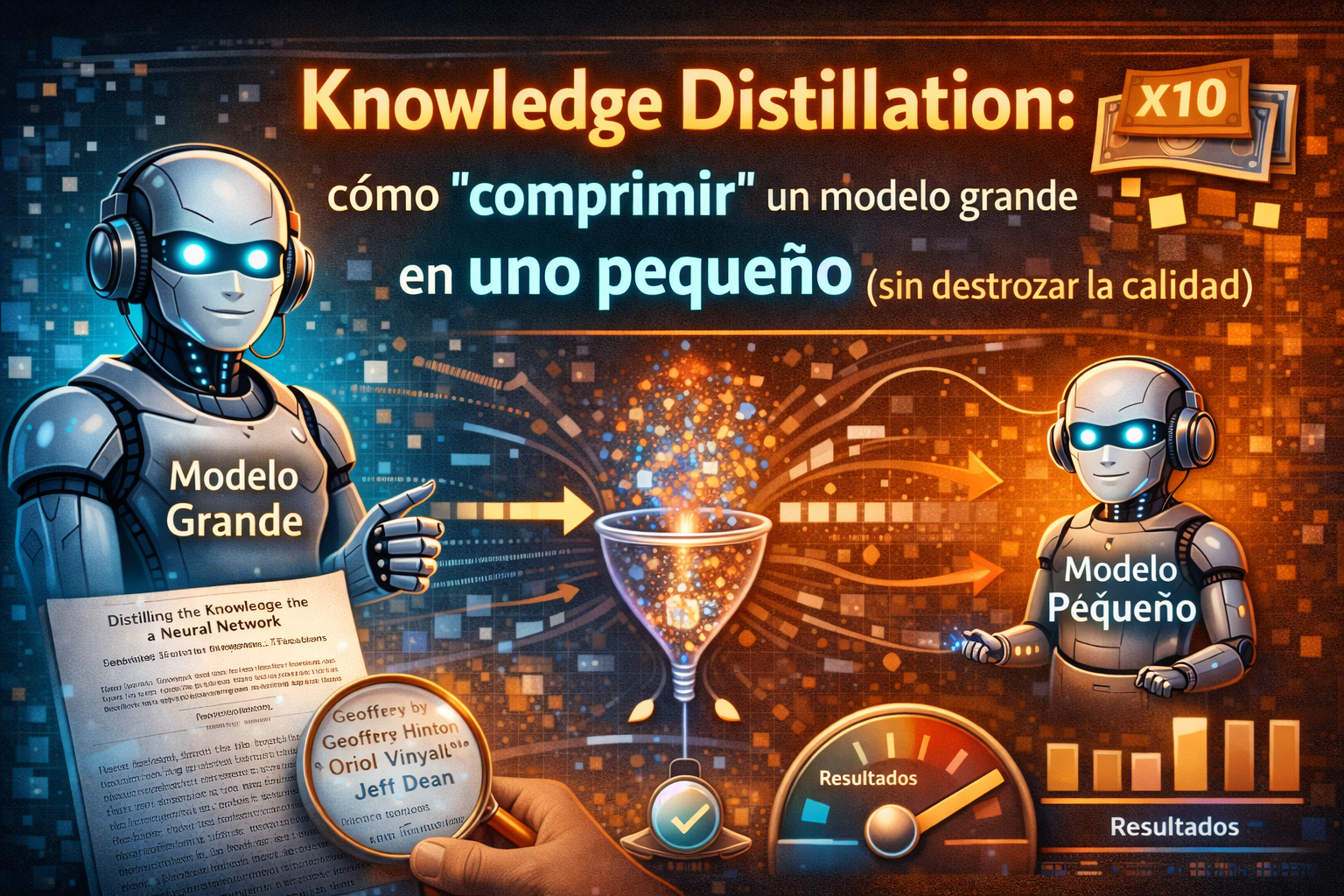

Knowledge Distillation: cómo “comprimir” un modelo grande en uno pequeño (sin destrozar la calidad)

Del paper clásico de Hinton a LLM modernos: qué se transfiere, cuándo funciona, y casos reales donde ahorras coste por x10.

INTELIGENCIA ARTIFICIAL

2/27/2026

Contacto

Estamos aquí para ayudarte a simplificar.

contacto@moriahtechia.com

© 2025. All rights reserved.